Dalla mailing list di Spaghetti Open Data (impagabile) raccolgo e rilancio due segnalazioni di questi giorni che mi sembrano interessanti.

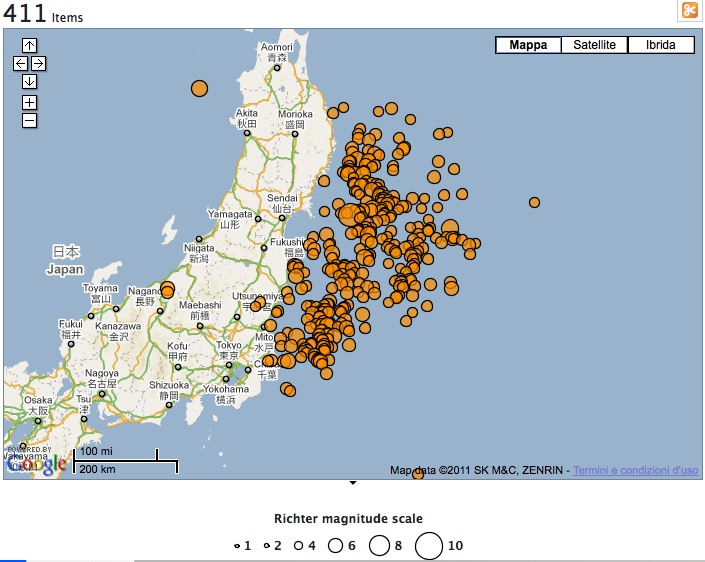

- la prima è la straordinaria demo di data.gov sui terremoti. Pesca da un dataset di terremoti, archiviati per intensità e coordinate geografiche, e restituisce una mappa dei terremoti dell’ultima settimana. Siccome è aggiornata dinamicamente, la visualizzazione cambia nel tempo: qui sopra mostro uno screengrab che fa vedere i 300 e passa eventi sismici avvenuti in Giappone questa settimana, su oltre 400 in tutto il mondo (hat tip: Matteo Brunati). Riccardo Strobbia ha costruito uno strumento simile, stringendo i limiti temporali della query per avere una visualizzazione dei terremoti in tempo reale (hat tip: Federico Bo)

- la seconda è utile per temperare i nostri entusiasmi per i dati aperti con le difficoltà molto reali di manipolazione. Eric Sanna ha pubblicato una specie di tutorial per costruire un semplice grafico a partire dal dataset di assenze dal lavoro dei dipendenti del Consiglio Nazionale delle Ricerche, la cui pubblicazione, come forse ricorderete, è prevista dal decreto Brunetta. Il CNR, come purtroppo molti enti e agenzie, ha pubblicato sì i dati, ma in formato PDF, quindi pochissimo aperto. A forza di smanettare, Eric riesce a passare da PDF a Excel, e da Excel a un grafico. Però ci mette un’ora e mezza: lui, che in quanto a rapporto con i dati è decisamente più attrezzato del cittadino medio (lavora all’ISTAT)! Inoltre, il lavoro descritto da Eric serve solo a fluidificare i dati e mostrarli, mentre si ferma alla soglia dell’elaborazione vera e propria – cioè della fase che potrebbe strappare ai dati qualche segreto, qualche intuizione. Per esempio: come interpretare il picco di assenze in agosto? Conclusione: manipolare i dati è faticoso, e lo rimarrà ancora a lungo. C’è ancora molto lavoro da fare per rendere i dati pubblici veramente fruibili, e fino a che non lo saranno il loro potenziale rimarrà ancora, almeno in parte, inespresso.